electric guillaume

keine Information

Von Suno war ich noch nicht soo überzeugt, aber Udio finde ich schon sehr beeindruckend.

Folge dem Video um zu sehen, wie unsere Website als Web-App auf dem Startbildschirm installiert werden kann.

Anmerkung: This feature may not be available in some browsers.

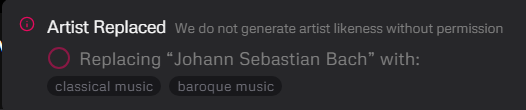

... und jetzt stell dir vor, das geht auch mit Video, dann ist jeder der nächste Spielberg oder Kubrik.jetzt nimm Jon Lord an der Orgel, Jimi Hendix an der Gitarre, Mike Portnoy an den Drums und Jack Bruce am Bass und arbeite ihre Parts so aus wie sie es tun würden"....

Klar, so würde man es sich wünschen, aber:"jetzt nimm Jon Lord an der Orgel, Jimi Hendix an der Gitarre, Mike Portnoy an den Drums und Jack Bruce am Bass und arbeite ihre Parts so aus wie sie es tun würden"

Ich frag mich ja, ob das nur eine Frage der Betrachtung ist. Anders formuliert: Angenommen die Tools erfinden bereits neue Genres. Würden Menschen es überhaupt erkennen? Für jemanden, der sein leben lang nur Country hört und dann doch ein einziges Mal mit einem House und einem Techno Track konfrontiert wird - wäre der Unterschied zwischen den Genres überhaupt offensichtlich?Diese Maschine wird wohl aber keine Genres erfinden sondern sie aktuell nur dehnen und rekombinieren. Ein Maler könnte eben auch mal irgendwann auf die Idee kommen nicht mehr photorealistisch zu sein und das fehlt noch. Kubistisch sein ohne das es das je vorher gab. Die echten Grenzen ausloten.

Wäre das überhaupt wichtig oder irgendwie von Bedeutung?Ich frag mich ja, ob das nur eine Frage der Betrachtung ist. Anders formuliert: Angenommen die Tools erfinden bereits neue Genres. Würden Menschen es überhaupt erkennen?

Für mich subjektiv schon.Wäre das überhaupt wichtig oder irgendwie von Bedeutung?

Wie sieht denn der Schaffensprozess bei dir aus?Aber der Schaffensprozess wirkt wie aus der Zeit gefallen - und damit das, worüber ich mich als Musikmachender definiere.

Ist für mich eine Frage des Betrachtungszeitpunkts. Wenn ein Begriff neu ist, ist es für mich Synonym für eine Innovation. Wenn ein Genre ein paar Jahre existiert, verliert der jeweilige Begriff auch an Bedeutung für mich.Genres sind Schubladen. Kategorien nach denen man Musik sortiert. Ich schreibe ihnen keine große Bedeutung zu.

Wie sieht denn der Schaffensprozess bei dir aus?

Wir kannten ihm nur entgegnen, dass die Musik von Udio ect. nicht ihm gehört, sondern laut AGB der Firma. Er meinte aber, das sei kein Problem, er hätte einen Bezahlaccount und da würden alle Rechte ihm gehören.

Ist denn die Audioqualität von Udio kinogeeignet?

Wenn ich mir die Kinospots so im Mittel anschaue, die ja auch meistens kleinere örtliche Unternehmen bewerben, ist die Audioqualität manchmal deren kleinstes Problem.Ist denn die Audioqualität von Udio kinogeeignet?

Weil du dich angesprochen fühlst.Warum soll ich mir das anhören?

Weiß nicht, hab es mir nicht angehört.Was soll mir das sagen?

Findest du heraus wenn du reingehört hast.Was hat das mit mir zu tun?

Nein. Ich fühle mich nicht angesprochen, sondern belästigt. Niemand findet irgendetwas heraus, weil er sich das anhört. Wem soll ich zu seinem Song gratulieren? Musik ist Austausch zwischen Menschen. Das, was aus den Automaten kommt ist Maschinenlärm, der sich als Musik tarnt. DAS soll mich berühren? DAVON soll ich träumen? Wo bleibt Butler?Weil du dich angesprochen fühlst.

Weiß nicht, hab es mir nicht angehört.

Findest du heraus wenn du reingehört hast.

Wie ist denn das passiert?Nein. Ich fühle mich nicht angesprochen, sondern belästigt.

Nicht mehr..Musik ist Austausch zwischen Menschen.

kopiert bestehende Werke bestehender Künstler und verändert sie so weit, dass sie den Urheberrechtsgesetzen des Autors entgeht.“