AI ist noch immer irgendwie eine bessere Datenbank oder Big Data, ich glaube erst an echte KI, wenn das wirklich mehr als nur schlau verknüpft ist..

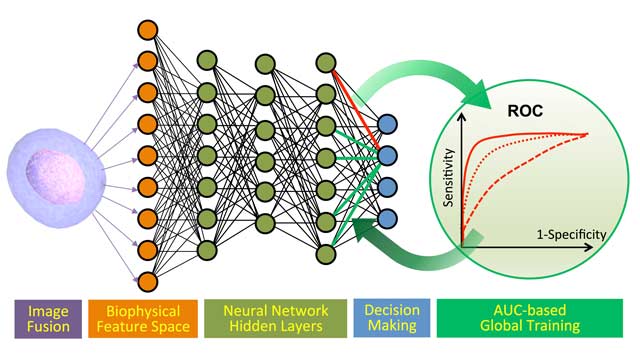

Das hast Du schon mal geschrieben aber was ich hier poste es sind neuronale Netze - Nachfolger des Perzeptrons -

- das ist schon was anderes.

Big Data gehört heute zwar dazu, für die Trainingsdaten.

Da werden dann mal eben 10.000 Bilder analysiert. Oder 100 Drehbücher.

Aber das wird nicht in Datenbanken abgelegt, sondern es wird ein neuronales Netz trainiert

das sich nach dem Input ausrichtet und adaptiv tatsächlich lernt.

Das Netz kann danach ganz ohne jede Datenbank Dinge erkennen.

Das Netz funktioniert in den meisten Aspekten wie biologische Nervennetze.

Da gab es riesen Fortschritte in den letzten 10 Jahren.

Kuck Dir mal das an zB

https://deepart.io/ - mit Datenbanken und Big Data oder alten Bildverarbeitunsgalgorithmen geht sowas nicht.

Das ist komplexe neuronale Mustererkennung und -verarbeitung.

Das Netzt "sieht" die Strukturen im Ausgangsbild und "träumt" die Struktur in das Zielbild.

Und zwar ganz ähnlich wie ein biologischer Sehapparat das verarbeitet.

Das ist keinerlei Datenbank dahinter und das hat mit der alten KI und sogenannten "Expertensystemen" ja nichts zu tun.

Bei so was wie Siri mag das anders sein, aber das ist ja im Prinzip nur eine Suchmaschine mit Spracheingabe.

Wobei auch da denke ich neuronale Netze für Teilaufgaben im Spiel sind.

Jeder dieser Knoten ist einfach nur eine simulierte Nervenzellenähnliche Struktur,

die je nach internem Zustand (Gewicht, Schwellenwert etc) und Inputlevel an die benachbarten Knoten "feuert"

oder nicht.

In dem Netz sind keine Daten abgelegt, und das Netz ist *wesentlich* kleiner als die Datenbank

an Dingen mit der es trainiert wurde.

Und es kann Dinge/Bilder erkennen die nicht in der Dtanebank waren - kuck Dir das Quickdraw DIng an zB.

Das ist ja der Witz daran.

Im ersten Layer werden Strukturen wie Kanten, Flächen, Ecken usw erkannt.

Was im zweiten passiert kann man mit Worten schon nicht mehr umschreiben.

Es weiß auch letztlich keiner warum und wie genau ein trainiertes Netz dann funktioniert, was es genau

intern mit welchen Knotenpunkten eigentlich macht.